Les modèles d'intelligence artificielle générative comme les grands modèles de langage (LLMs) ont révolutionné notre façon d'interagir avec la technologie. Cependant, ils présentent un défi majeur : les hallucinations. Ces réponses incorrectes ou incohérentes peuvent avoir des conséquences importantes pour les entreprises qui déploient ces technologies.

Qu'est-ce qu'une hallucination IA ?

Une hallucination IA se produit lorsqu'un modèle génère du contenu qui semble plausible mais qui est factuellemment incorrect ou inventé. Ces erreurs peuvent prendre plusieurs formes : citations inexistantes, références à des événements qui ne se sont jamais produits, ou création de liens logiques erronés entre des concepts.

Les hallucinations sont le talon d'Achille des modèles génératifs actuels. Elles représentent un obstacle majeur à l'adoption de ces technologies dans des contextes critiques où la précision est essentielle.

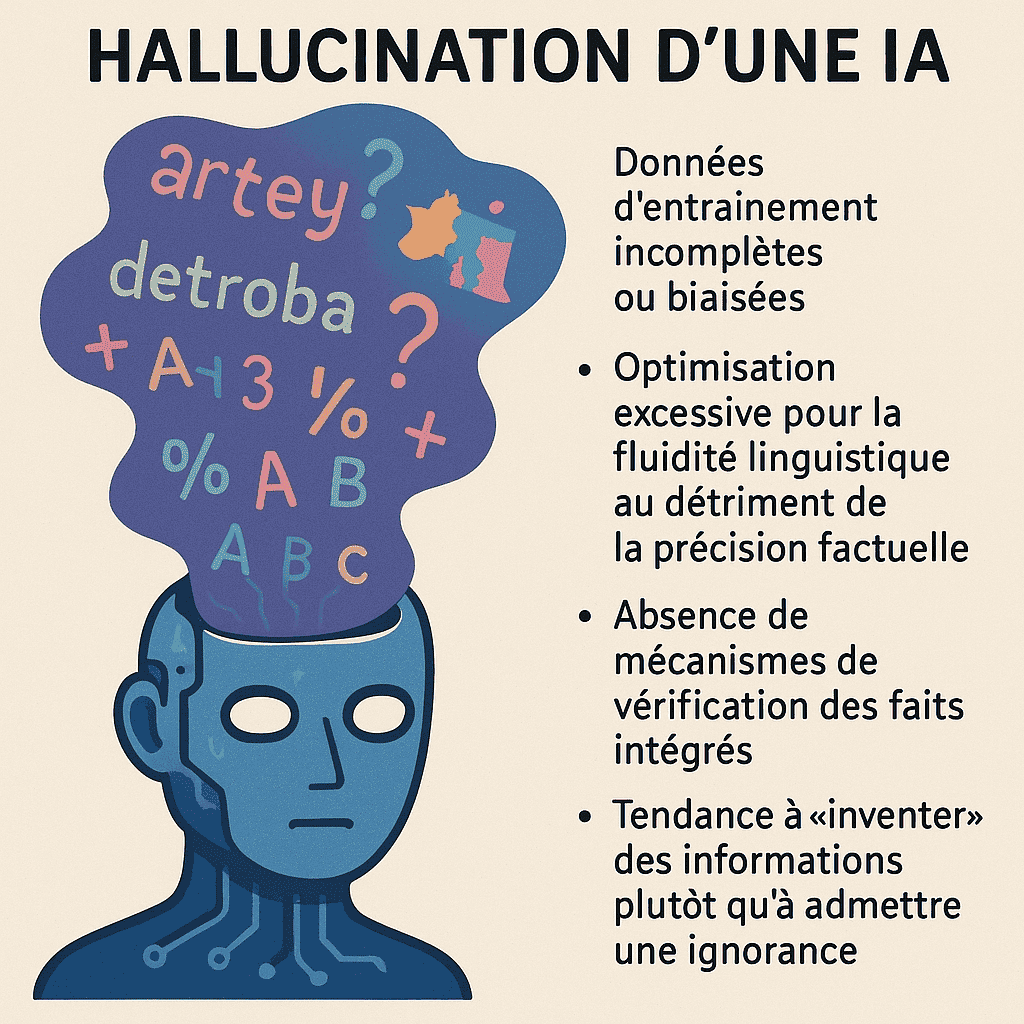

Pourquoi les modèles hallucinent-ils ?

Plusieurs facteurs contribuent aux hallucinations des modèles d'IA :

- Données d'entraînement incomplètes ou biaisées

- Optimisation excessive pour la fluidité linguistique au détriment de la précision factuelle

- Absence de mécanismes de vérification des faits intégrés

- Tendance à "inventer" des informations plutôt qu'à admettre une ignorance

- Manque de compréhension causale du monde réel

Impacts sur les entreprises

Pour les organisations qui déploient des solutions basées sur l'IA générative, les hallucinations représentent un risque significatif :

- Risques juridiques liés à la diffusion d'informations erronées

- Atteinte à la réputation et perte de confiance des utilisateurs

- Décisions commerciales basées sur des données incorrectes

- Coûts supplémentaires pour la vérification et la correction des erreurs

Stratégies de mitigation

1. Systèmes de vérification factuelle

L'intégration de systèmes automatisés de vérification des faits peut aider à identifier et filtrer les hallucinations avant qu'elles n'atteignent l'utilisateur final. Ces systèmes peuvent comparer les réponses générées avec des sources fiables et signaler les incohérences.

2. Approche RAG (Retrieval-Augmented Generation)

La génération augmentée par récupération (RAG) combine la puissance des modèles génératifs avec des systèmes de recherche d'information. En ancrant les réponses dans des documents vérifiés, cette approche réduit considérablement le risque d'hallucinations.

# Exemple simplifié d'implémentation RAG

from langchain import LLMChain, PromptTemplate

from langchain.llms import OpenAI

from langchain.retrievers import DocumentDB

# 1. Récupérer des documents pertinents

retriever = DocumentDB(documents=verified_documents)

relevantdocs = retriever.getrelevant_documents(query)

# 2. Construire un contexte à partir des documents

context = "\n".join([doc.pagecontent for doc in relevantdocs])

# 3. Générer une réponse ancrée dans ce contexte

prompt = PromptTemplate(

template="Contexte: {context}\n\nQuestion: {question}\n\nRéponse:",

input_variables=["context", "question"]

)

llm_chain = LLMChain(llm=OpenAI(), prompt=prompt)

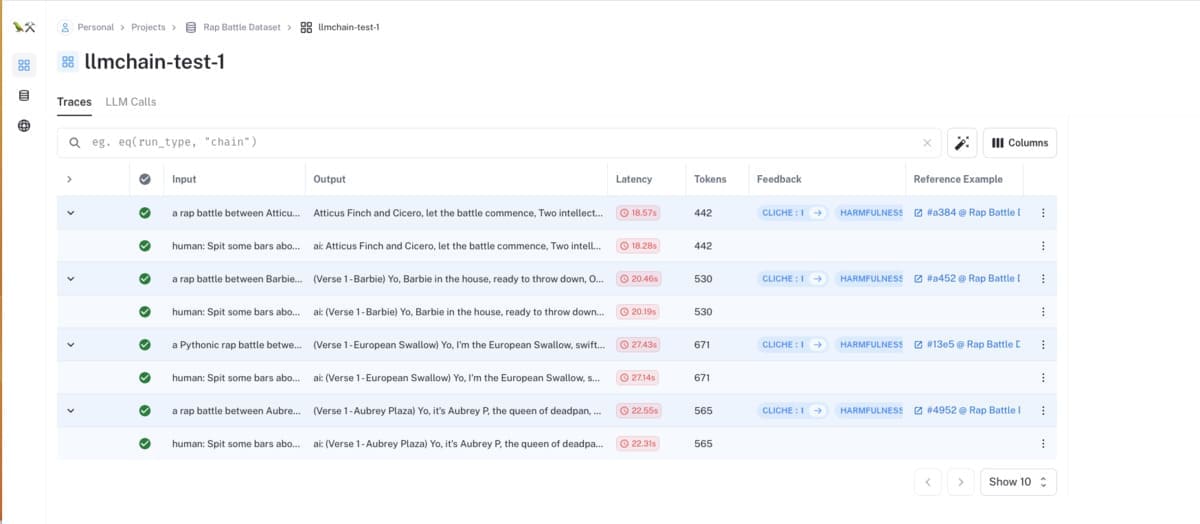

response = llm_chain.run(context=context, question=query)3. Monitoring en temps réel

La mise en place d'un système de surveillance continue permet de détecter les hallucinations et d'améliorer progressivement la qualité des réponses. Ce monitoring peut inclure des métriques de confiance, des signalements utilisateurs et des audits réguliers.

Vers des modèles plus fiables

La recherche dans le domaine de l'IA progresse rapidement pour résoudre le problème des hallucinations. Les approches prometteuses incluent l'entraînement avec feedback humain (RLHF), les modèles d'incertitude explicites, et les architectures qui séparent la génération de la vérification factuelle.

Pour les entreprises qui souhaitent tirer parti de l'IA générative tout en minimisant les risques, une approche prudente et méthodique est essentielle. Cela implique de comprendre les limites des modèles, de mettre en place des garde-fous appropriés, et de maintenir une supervision humaine dans les processus critiques.

L'avenir de l'IA générative ne réside pas dans l'élimination complète des hallucinations, mais dans notre capacité à les détecter, les comprendre et les gérer efficacement.